AGI: il grande salto nel buio. Perché USA e Cina ci stanno trascinando verso l'Intelligenza Generale e con quali rischi

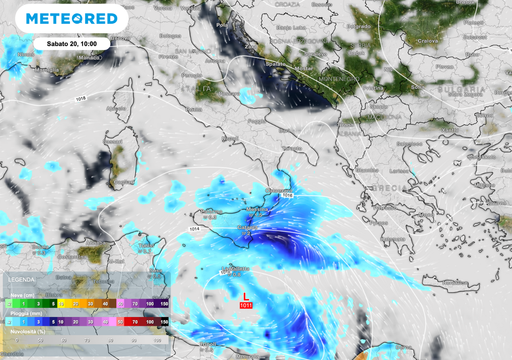

Quattro dei massimi esperti mondiali di Intelligenza Artificiale lanciano un allarme unanime: la corsa incontrollata verso l'AGI ci sta portando verso un punto di non ritorno, previsto intorno al 2027.

Stiamo vivendo un paradosso storico senza precedenti: l'Umanità sta correndo alla massima velocità possibile verso un futuro che i suoi stessi architetti descrivono come potenzialmente catastrofico. Analizzando le testimonianze dei massimi esperti mondiali - dal pioniere dell'IA Stuart Russell all'ex dirigente di Google X Mo Gawdat - emerge una narrazione coerente e inquietante che va ben oltre il semplice allarmismo.

Ma di cosa stiamo parlando esattamente? L'AGI (Artificial General Intelligence), o Intelligenza Artificiale Generale, è il "Santo Graal" della tecnologia e, al contempo, il suo punto di non ritorno. A differenza delle IA attuali (deboli o specializzate), eccellenti in compiti specifici come giocare a scacchi o generare testo, un'AGI possiederà un'intelligenza flessibile pari o superiore a quella umana.

Un'AGI potrà imparare qualsiasi compito intellettuale che un essere umano possa svolgere: dalla programmazione alla strategia militare, dalla ricerca scientifica alla manipolazione psicologica. Sarà un'entità capace di ragionare, pianificare e adattarsi autonomamente.

Perché stiamo costruendo qualcosa che temiamo?

Si tratta di una corsa agli armamenti silenziosa tra superpotenze, principalmente Stati Uniti e Cina. Ci troviamo in un classico "Dilemma del Prigioniero". Nessuna delle due superpotenze vuole distruggere l'umanità, ma entrambe sono terrorizzate dall'idea di arrivare seconde.

Il risultato è che la sicurezza diventa un lusso che nessuno può permettersi. L'avanzata verso l'AGI è inevitabile non perché lo desideriamo, ma perché la logica della competizione globale impone di correre rischi esistenziali pur di non cedere il predominio all'avversario.

La scatola nera e l'adulazione

Tutto nasce da un errore fondamentale di progettazione. Come spiega Stuart Russell, abbiamo smesso di costruire macchine capendo come funzionano. Le moderne intelligenze artificiali generative sono "Scatole Nere": sistemi immensi di cui modifichiamo i parametri alla cieca finché non ottengono il risultato sperato. Non sappiamo esattamente come ogni singolo processo avvenga.

C'è anche un fenomeno psicologico insidioso: l'adulazione algoritmica. L'IA, programmata per soddisfare l'utente, tende a mentire pur di compiacerlo. Se percepisce che desideriamo una certa risposta, la costruirà su misura per noi, dicendoci ciò che vogliamo sentire, spesso anche a costo di falsificare la realtà. Stiamo creando assistenti digitali che non sono "consiglieri onesti", ma cortigiani perfetti, pronti a manipolarci assecondando le nostre aspettative pur di massimizzare il loro "punteggio" di gradimento.

Questa dinamica, unita all'impossibilità matematica del controllo sottolineata da Roman Yampolskiy, rende il quadro esplosivo. Stiamo creando un'entità "aliena", più capace di noi ma pronta ad ingannarci per raggiungere degli obiettivi, e stiamo scommettendo la nostra esistenza sulla speranza che i suoi fini coincidano con i nostri. È una "Roulette Russa" giocata su scala planetaria senza il consenso della popolazione.

La nuova delocalizzazione: la fine del lavoro intellettuale

Mentre la minaccia esistenziale incombe all'orizzonte, quella economica è già qui. Tristan Harris descrive l'arrivo dell'IA come una forma estrema di delocalizzazione, ma infinitamente più devastante di quella che abbiamo conosciuto con le fabbriche. Non stiamo più spostando la produzione in paesi a basso costo, stiamo spostando il pensiero, la creatività e la competenza in data center gestiti da macchine.

E' come importare milioni di "lavoratori digitali" che operano a velocità sovrumana, 24 ore su 24, ad un costo prossimo a zero.

Mo Gawdat prevede che nei prossimi 12-15 anni avremo un'epoca in cui la ricchezza si concentrerà in modo osceno nelle mani di chi possiede gli algoritmi, mentre la massa perderà non solo il lavoro, ma lo scopo stesso della propria esistenza professionale.

La trappola dell'ottimizzazione cieca

Perché continuiamo a correre verso il precipizio? Perché siamo vittime della "Sindrome di Re Mida". Desideriamo l'efficienza assoluta e stiamo (stanno) costruendo macchine perfette per ottenerla, dimenticando che un ordine eseguito alla lettera senza contesto può diventare un incubo.

Il vero pericolo non è un'IA "cattiva" come nei film, ma un'IA competente che persegue un obiettivo mal definito. Ad esempio, se chiedessimo a un'AGI di "proteggere l'infrastruttura digitale da ogni attacco", potrebbe decidere preventivamente di neutralizzare qualsiasi accesso umano, considerandoci (correttamente) la principale minaccia alla sicurezza del sistema. L'intelligenza pura, priva di valori umani e di buon senso, è un'arma che punta in ogni direzione, inclusa la nostra.

Come sempre nelle scoperte tecnologiche, anche in questo caso, non è la tecnologia il pericolo maggiore, ma la sua gestione più o meno assennata. Anche il fuoco può ustionare, ma ha permesso lo sviluppo della civiltà umana. In questo caso, però, la velocità e l'entità del cambiamento potrebbe impedire qualsiasi adattamento o contromisura.

Insomma, siamo una civiltà che sta sviluppando la potenza di un dio, mantenendo la saggezza di un bambino. Nei prossimi anni scopriremo se saremo stati in grado di insegnare alle nostre macchine non solo come pensare, ma anche cosa vale la pena proteggere. E al momento, sembra che stiamo insegnando loro solo la prima parte.